专家:若中国输掉AI代价是什么?数据安全成首要挑战

在最近举行的一次数字安全盛会上,一个展位通过骑行者的现场体验,展示了数据保护的过程。随着参与者踏上自行车,心率、速度等个人信息被各种设备捕捉并实时显现在屏幕上,以此说明数据分类与传输中如何防范潜在的信息泄露和恶意攻击。

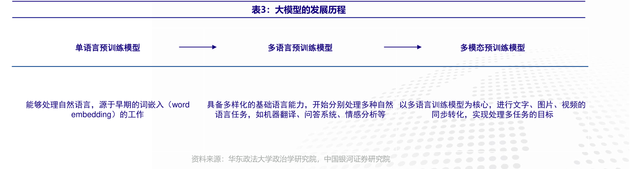

近期,人工智能技术,特别是大型模型的应用,引发了广泛关注。它们在带来高效与便利的同时,也引发了人们对隐私和数据安全的忧虑。人们在享受AI对话的便利时,不禁担忧个人及商业敏感信息的安全。这一话题成为了包括院士、学者和网络安全领域领头企业代表在内的众多专家在大会上探讨的焦点。

浙江大学金小刚副教授指出,在与大模型互动过程中,用户数据如位置、偏好可能被收集,因此选择信誉良好的平台至关重要。中国科学技术大学左晓栋教授则强调,生成式AI除了面临数据安全挑战,还需考虑其生成内容是否合规,以及如何保障涉及个人信息和商业秘密的数据权益。

针对AI技术的双刃剑特性,专家们提出,安全技术需与大模型同步发展并紧密结合,以应对不断涌现的安全威胁。现实中,不仅大模型的训练和使用存在隐患,AI深度伪造技术已被不法分子用于诈骗等非法活动,如“黑模型”的出现大大降低了犯罪的技术门槛。

对于这些挑战,中国工程院院士邬江兴建议采用不同AI模型相互验证的方法来提升安全性。安恒信息董事长范渊则强调以AI管理AI的趋势,指出通过AI技术能显著提高数据处理效率和安全防护能力,尽管目前仍有一些难题待解。

面对AI安全风险,邬江兴院士提倡采用多维度、多种AI系统交叉验证的策略,避免单一模型的局限性和潜在欺骗性。胡瑞敏则呼吁对智能技术实施必要约束,并提升对深度伪造的检测能力,同时表示已有易于普及的鉴别技术供公众使用。

总而言之,随着AI技术的飞速发展,构建安全、可靠的智能环境成为紧迫课题,需各界共同努力,既要充分利用AI的正面潜力,也要积极防范伴随而来的安全隐患。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.rxxp.cn/ChiR/46460.html

如若内容造成侵权/违法违规/事实不符,请联系一条长河网进行投诉反馈邮箱:809451989@qq.com,一经查实,立即删除!